H2PTM (1989) Mazeau

Des espaces vidéo interactifs

|

Sommaire

- 1 Introduction

- 2 L'espace physique

- 3 Les nouveaux espaces virtuels.

- 4 Le nouvel espace physique

- 5 Les objets utilisés dans les espaces interactifs.

- 6 Le but de l'espace interactif

- 7 Les situations en fonction des objets

- 8 Les matériels de développement

- 9 Exemple d’un espace interactif.

- 10 Le voyage en autobus

- 11 Conclusion : l’objectif des travaux

- 12 Notes

Introduction

La présente communication traite du dialogue homme-machine, plus particulièrement d'un dialogue homme-image[1].

Elle propose une solution qui permet de contrôler en temps réel les déplacements d'un sujet ou d'un objet, à l’intérieur d’une surface «propre», délimitée certes, mais pouvant atteindre plusieurs dizaines de mètres carrés. Le contrôle de l’espace est nécessaire à la maîtrise des déplacements, qui sont utilisés ici pour interagir quasi «naturellement» avec des banques de données, contenant des images et des sons.

Les matériels courants nécessaires à l'interactivité homme-machine au travers d’images et de sons se situent souvent dans un espace géographique très réduit. Celui-ci, meublé d’une chaise et d’une table sur laquelle est ergonomiquement posé un écran, permet à l'utilisateur de dialoguer confortablement avec cet écran.

Un tel dispositif de consultation, sans doute adéquat pour le lecteur ou l’écrivain, n'est peut-être pas l'idéal du promeneur.

Il l’est moins encore si on ajoute à notre premier inventaire, parfois luxueux mais toujours exigu, les objets hétéroclites qui le complètent : lecteurs externes, imprimantes, claviers... Ces derniers sont parfaitement adaptés au vermillon des ongles impeccables des opératrices de saisie, de traitement et de manipulation de textes. N’oublions pas les souris, variées et troublantes, moulées dans des matériaux hautement plastiques, manipulées par des mains expertes, roulées sur les tapis les plus moelleux, qui sont devenues un des maillons indispensables à la communication homme-machine. Ajoutons encore les écrans-tactiles, les «joysticks », les « track-balls », tous les outils habituel—lement utilisés pour interagir avec l'image, et les téléviseurs immobiles, cracheurs d’images et de sons, qui s’emparent en retour, dans la communication machine-homme, des capteurs dont sont dotés les êtres vivants, généralement les yeux et les oreilles.

Voici que ces objets, destinés à exécuter les ordres dans une situation de communication institutionnelle claire, par exemple en bureautique, attendent le touriste, l’invitent à déambuler parmi les toiles du Louvre ou à arpenter en galopant les rues sinueuses de San-Francisco. Celui qui cède à la tentation est aussitôt poussé sur le tabouret, pris en main, ses sens liés aux fonctionnalités de la machine. C’est la semaine du carnaval, le monde à l’envers : la machinerie s’active et réduit le touriste à la passivité.

Cette caricature d'un poste de travail «interactif» nous amène à décomposer un espace interactif en deux parties :

- un espace physique occupé par le mobilier et le sujet assis — cet espace est immobile ;

- un espace virtuel organisé par l'information audiovisuelle — celui-ci est obligatoirement dynamique.

L'espace physique

Cet espace couvre des champs applicatifs importants tels que ceux qui font appel au textuel — écriture de textes ou consultations de données. Par contre les outils qui permettent les déplacements dans des espaces virtuels apparaissent souvent comme paralysants. Quelle promenade pouvez-vous effectuer, quel musée pouvez-vous visiter, coincé sur une chaise ou vautré dans votre fauteuil ? Sommes-nous tous des culs-de-jatte ?

Nous rejetons comme anti-physique le modèle de déambulation sur lequel repose souvent les visites interactives. Comment déambuler dans un musée alors que vous êtes assis, arrimé à votre machine, dans votre fauteuil sans roulette, la main droite caressant votre souris, la main gauche accrochée à votre manche à balais ? A Icare nous proposons de s'émanciper de la machine et d'évoluer dans un espace plus aéré, de démolir lentement les murs.

Pouvons-nous vraiment en effet appréhender l'espace dans un environnement physique aussi restreint qu’un ensemble meublant de bureau ? Jusqu’où peut aller la force de l’imaginaire ?

Il n'est pas de notre ressort de répondre dans sa généralité à une telle question.

Notre démarche est amplement de rechercher un agrandissement de l'espace physique, de le porter par exemple aux dimensions d'une salle de séjour, d'une salle de classe, d'un autobus, d'un espace dans lequel l'utilisateur échappe au confinement et jouisse au moins de quelque liberté dans ses allées et venues.

C'est la connaissance des déplacements qui génère l'information indispensable pour la maîtrise du processus interactif. La commande nécessaire au processus interactif n'est plus attachée à un objet sur lequel l'homme doit intervenir, il est le déplacement de l'homme lui-même.

Nous essayons Id de proposer un moyen pour contrôler les déplacements d'un sujet et de cerner les classes d’applications qui peuvent tirer quelque profit de ce type d'ergonomie forcément limitée à des espaces spécifiques. Cette approche implique bien entendu la maîtrise des systèmes matériels et logiciels qui permettent de contrôler les déplacements du sujet ou des objets dans l'espace physique.

Les nouveaux espaces virtuels.

Ce sont des contextes audiovisuels qui « habillent » l'espace physique et le transforment en une scène donnée dans laquelle le sujet se trouve en situation. C'est une cuisine dans laquelle l'homme ou la femme vont se déplacer, c’est une piste pour des automobiles sur laquelle les voitures s’affrontent ou s’évitent, c’est un autobus dans lequel un individu voyage.

Où est représenté l’espace virtuel ?

L'espace virtuel est concrétisé dans un espace spécifique de représentation constitué par des écrans de télévision dont le nombre et l’organisation dépendent naturellement du choix de l'auteur et du type d'application.

Comment représenter l'espace virtuel ? Doit-on représenter les quatre murs d'une pièce par quatre téléviseurs ? Devront-ils diffuser quatre séquences différentes pour restituer l'espace réel ? Peut-on représenter l'espace sur un seul téléviseur? Les moniteurs sont-ils à l'intérieur ou à l'extérieur de l'espace physique ?

Telles sont les questions auxquelles devra répondre l'auteur de l'application.

Nous appelons « intérieur » d'un espace physique la partie de l'espace contrôlée par la caméra.

Le nouvel espace physique

Donnons quelques définitions un peu sèches pour préciser les choses.

L’espace peut atteindre une surface de l'ordre d'une quarantaine de mètres carrés.

Quel est l'organe d'observation de cet espace ? C'est une caméra vidéo. Elle transmet un « plan image ».

Qu'est ce qu'un plan image ?

C'est un signal périodique qui représente ici l'image de la scène observée. Cette scène est observée vingt cinq fois par seconde et le plan est renouvelé à la même fréquence.

Chaque image du plan est composée de deux trames, une trame paire et une trame impaire. Chaque trame contient trois cent dix-neuf lignes.

L'information contenue dans ces deux trames est identique, mais décalée. Cette information étant redondante, nous utilisons seulement la trame paire, L'analyse de la trame (n) et la mise en place des données indispensables au traitement de la trame (n+1) sont effectuées pendant la durée de la trame impaire. A un instant donné, plusieurs plans images sont utilisés par l'analyseur.

Dans les applications de type « espace vidéo interactif », le plan qui représente l'espace physique a un statut spécifique : il est le « plan maître ».

Le plan maître doit asservir en durée et en phase l’ensemble des plans utilisés pour le traitement. Ce qui signifie que toutes les trames et toutes les lignes des trames qui représentent un plan doivent impérativement commencer et finir au même instant Si cette condition est implie, nous dirons que les plans sont compatibles.

Que traite t-on dans le plan observé par la caméra ?

La caméra utilisée délivre les composantes couleurrrouge,vert,bleu (R.V.B). Ces composantes sont de nature analogique. L'amplitude de chaque composante caractérise le plan.

Nous ne retiendrons pour le traitement que deux possibilités pour chacune des composantes : la présence ou l'absence. Pour le calcul nous traitons trois variables binaires par plan image. Ce qui permet de distinguer dans l'image analysée un maximum de deux à la puissance trois, soit huit zones dans l'espace physique.

Ces zones spécifient la présence ou l'absence de chacune des composantes. Elles sont définies dans l'espace physique par huit couleurs.

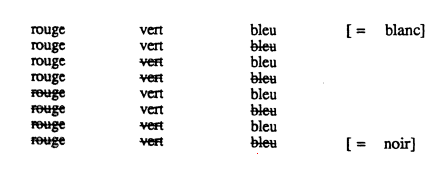

Résumons-les dans un tableau (en biffant les composantes absentes) :

La présence ou 1 absence d'une composante est relative : elle est fonction d'un seuil, déterminé pour chacune d'elle.

Quelles sont enfin les nuances de couleurs contenues dans les huit couleurs traitées? Toutes les

nuances de couleur de I espace physique, dont le niveau est inférieur au niveau du seuil vont

positionner la variable correspondante à zéro. Une couleur va donc regrouper toutes les

nuances comprises entre le niveau zéro et le seuil, et les nuances comprises entre le seuil et le niveau maximum.

Que représentent ces zones dans l'espace physique ? Par exemple :

- des objets immobiles : chaises, arbre...

- des objets mobiles : voitures, avions...

- des sujets : humains ou animaux...

- des découpages naturels ou artificiels de l'espace physique...

Si ! éclairage découpe l'espace physique vide en plusieurs couleurs (parmi les huit), nous parlerons de découpage naturel. Si pour un éclairage donné l'espace physique vide appartient à une couleur unique, toute autre couleur résultera d'un découpage artificiel. Dans tous les cas, chaque zone de l'espace physique - objets,sujets.découpages - est rangée dans une des huit couleurs utilisées pour le traitement Les personnes qui évoluent dans l'espace physique sont considérées par l'analyseur comme des zones. Ils apprennent forcément à une ou plusieurs des huit couleurs.

Remarque : Les définitions précédentes peuvent laisser penser que le nombre de zones distinctes est limité à huit. Ce n'est pas le cas. En effet chaque zone peut être localisée par rapport à des zones de référence contenues dans des "données iconiques".

Une illustration : le citronnier (vert) placé dans le coin droit de l'espace physique n’est heureusement pas confondu avec le fourreau (vert) du mannequin qui sorvole les blanches de la maison de couture. Les zones réservées à chaque « chose verte » sont décrite dans des « données iconiques ».

- Sur les données iconiques

Les données iconiques sont des zones de référence qui sont utilisées pour l'analyse de l'espace physique. Elles sont contenues dans un plan image qui est compatible avec le plan à analyser. Cette compatibilité permet à un processeur spécialisé d'établir des relations directes entre le plan qui représente l'espace physique,et les plans qui contiennent les données iconiques,ou entre plusieurs espaces physiques indépendants.

Une relation directe établit un lien entre les zones des divers plans qui interviennent dans le processus d'identification. Cette relation s'établit à la vitesse de déplacement du spot qui décrit une image sur un écran. La relation directe la plus complexe traite, à un instant donné, toutes les variables (composantes RVB) de tous les plans. En voici une illustration sous forme de question. Le mannequin « vert pâle », considéré par l'analyseur comme étant une zone de couleur "verte" dans le plan physique, et le mannequin « vieux rose », connu par une sont « rouge » dans l'espace physique, se déplacent-t-ils dans le labyrinthe représenté par la donnée iconique blanche du plan de référence 1 dans la donnée iconique jaune du même plan de référence, ou dans la donnée iconique jaune du pian de référence 2 ?

Le temps de réponse à cette question est de un cinquantième de seconde, la durée d une trame Cette performance n’est sans doute pas indispensable pour traiter des « espaces interactifs » où le dialogue avec le sujet est réalisé au moyen d'images et de sons. Elle se révèle plus intéressante pour interagir sur un objet en déplacement très rapide, ou pour étudier tel déplacements d'un objet.

- Sur l'édition des données iconiques

Les données iconiques sont incluses dans des plans image. Pour l'édition de ces données l'auteur emploie les logiciels de dessin commercialisés par le constructeur du micro-ordinateur (paint, draw). Ces logiciels peuvent s’utiliser sur une image naturelle ou synthétique « incrustée ». Elle représente le fond de l'écran. Cette image peut être la représentation de l'espace physique. La caméra est alors utilisée pour l'édition des données iconiques, édition directement réalisée dans l'espace physique. Quand les formes sont créées, l'auteur les « remplit » avec les huit couleurs utilisées lors du traitement.

L’auteur peut créer autant de données iconiques qu'il le désire, à raison de huit données par image Seules huit données sont analysées dans un plan. Si (d) données sont utilisée à un instant (donné, l'auteur doit créer (d/8) images. Ces images sont exploitées en séquences par l'analyseur, chaque image nécessitant un temps d'analyse d'une trame. L'auteur peut écrire un scénario qui plusieurs centaines, voire plusieurs milliers de données iconiques pour un espace physique donné. Une fois terminée, chaque image contenant les données iconiques est temporairement archivée sur une des mémoires de masse du micro ordinateur.

- Comment ces données sont-elles utilisées ?

Rappelons qu'un groupement de huit données iconiques est « encadré » dans une image, que les images et que les « données iconiques » n'ont aucun rapport direct avec les images visualisées sur l'écran. Ces dernières relèvent d'une utilisation « ordinaire » des banques d'images.

Pour l'exploitation de ces données, l'auteur doit tenir compte de quatre facteurs.

- Le nombre de données totales utilisées lors de l'application

- La dynamique d'utilisation de ces données (vitesse de défilement des données organisées en séquence, temps d'accès à des données non séquentielles).

- Le nombre de plans utilisés simultanément, à raison de huit données par plan.

- Sur la quantité de données iconiques.

Si le nombre de données est inférieur à une centaine d'images nous archivons les données sur le disque dur du micro-ordinateur, s'il est supérieur, nous les stockons sur un vidéodisque.

- Sur la dynamique de leur utilisation.

Dans les applications de type « espace virtuel », le déplacement des sujets est lent et le nombre de données utilisées pour effectuer une analyse est faible. Le problème du support n' est pas critique. Pour le contrôle ou l'analyse d'objets qui se déplacent très rapidement, le vidéodisque est le support le plus performant : il permet d'utiliser les données à un rythme de vingt-cinq trames par seconde. Dans une fourchette d'une centaine d'images, il permet d'orga-niser selon une séquence déterminée des données iconiques archivées séquentiellement.

- Sur le nombre de plans images.

Dans les applications de type "espace virtuel" nous n’utilisons que deux plans image.

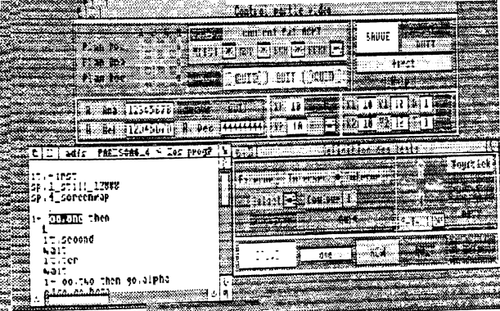

- Sur l'édition des applications

Un éditeur d'applications est actuellement développé par Emmanuel Decobecq étudiant de la maîtrise MIME (Micro Informatique Micro Électronique).

Il traite les éléments suivants :

- deux banques de données d images destinées à présenter l'information sur les espaces virtuels. La première est archivée sur un vidéodisque, la seconde sur un disque dur.

— une banque de données d'images qui supporte les données iconiques. Actuellement ces images sont archivées sur un disque dur. Nous prévoyons dans le futur un archivage massif sur vidéodisque ou sur tout autre support ou l'information est accessible en RVB.

- la caméra qui saisit l'espace physique.

L'éditeur permet de fabriquer des items.

L’item contient :

- des informations qui alimentent l’espace virtuel en séquences audio-visuelles ou en images numériques ;

- des informations qui sélectionnent les données iconiques, destinées à l'analyse de l’espace physique ;

- des informations permettant de prendre des décisions par rapport à l'espace physique ;

- les chaînages associés à ces décisions.

Une page écran qui contient deux fenêtres permet de créer un item.

Détail d'un item

- /* item de test */

pa.controle

- /*controle de différents éléments tels que les associations */

- /*de couleur, découpages (fenêtre 1) */

sp.icône-nom icône-50_100

- /*positionnement de la référence iconique */

then sp. still-12000

- /*condition vraie : sélection de l'image 12000 */

else sp-3400

- /*condition fausse : sélection de l'image 3400 */

end.

Sur la forme (des zones de l'espace physique ou des données iconiques.

Les zones étant représentées par une couleur, il n'y a pas de limitation à leur complexité.

Les objets utilisés dans les espaces interactifs.

Il peut indifféremment s’agir

- d'objets « concrets » ou d’objets dessinés.

Nous avons vu qu’ils s’agissait de meubles, de véhicules, de taches de couleurs, etc. Ils occupent l'espace physique. Ces objets sont tous visibles pour les sujets.

- d’objets virtuels ou « invisibles ».

Ils ont représentés dans des images sous la forme de données iconiques. Ils peuvent être placés et déplacés par rapport à l'espace physique. Ces objets simulés sont invisibles dans l’espace physique; par contre il est possible d‘en donner une représentation dans l' espace virtuel : le sujet se « cogne » à une personne invisible, laquelle peut être représentée dans l’espace virtuel par une photographie, une séquence filmique, un son... Ces objets simulés ou matériels sont utilisés pour contrôler le déplacement des sujets dans l'espace physique. L'évolution de l'espace virtuel peut dépendre du déplacement de l'utilisateur dans l’espace physique. Prenons le cas d’un sujet qui se dirige vers un mur (un écran) où sont accrochés trois tableaux. Si le sujet se déplace vers la droite, il choisit le tableau de droite, la toile lui est présentée en plein écran. Il s'approche, se dirige vers la droite : un grossissement de la partie droite est effectué sur le tableau...

Pour que des objets puissent provoquer des décisions différentes dans les processus interactifs, ils doivent appartenir à une couleur différente s’ils sont repérés par rapport à la même donnée iconique. S’ils appartiennent à la même couleur, l'analyse est effectuée avec des données iconiques distinctes.

Le but de l'espace interactif

Le but est de mettre le sujet dans des situations différentes, de façon à le faire interagir

avec l'environnement.

Les situations en fonction des objets

Examinons d'abord le cas où les objets sont substantialisés dans l’espace physique par des taches de couleur peintes sur une surface ou des meubles disposés dans le local. Cet environnement permet de traiter des scénarios interactifs où le sujet doit se déplacer par rapport à des objets qu'il perçoit et qu'il peut utiliser, palper. Il choisit de s'asseoir sur sa chaise préférée, de se coucher sur un lit moelleux. Le sujet a aussi la liberté d'agir sur les objets, exemples de les organiser dans l'espace. En ce cas, le but du dispositif interactif est de contrôler l'organisation et l'utilisation de ces objets, afin d'en vérifier l'acceptabilité. Le fauteuil a-t-il été placé dans une zone autorisée ou interdites?

Examinons ensuite le cas où les objets sont des composantes simulées de l’espace physique. Le sujet manipule les objets à travers le processus interactif; cette manipulation peut se révéler «inconsciente» si l'objet manipulé n'est pas représenté dans l'espace virtuel Ce principe permet d organiser de véritables découvertes dans des espaces imaginaires qui peuvent être représentes sur les écrans ou qui doivent être organisés et mémorisés par le sujet

Les matériels de développement

Le système matériel se compose de trois parties :

- l'organe de saisie de l'espace physique, une caméra R.V.B

- la machine hôte contrétisée par un micro-ordinateur (Archimède de chez Acom-Computer

- un processeur spécialisé dans le traitement en temps réel des données iconiques et des images en provenance de la caméra.

Ce processeur est développé par le laboratoire L.T.C.M. Il a la particularité de travailler sur plusieurs plans image simultanément. Les tâches qu'il effectue sont de calculer te surfaces de tous les objets qui se trouvent dans les plans image utilisés et d'évaluer les relations qui existent entre des objets de même nature dans les plans image considérés. Ces relations sont des opérations logiques spécifiques qui peuvent traiter l’ensemble des variables qui caracté-risent les plans image. Ces relations sont programmées dans le silicium. Le processeur est conçu pour exécuter un jeu d’instruction « utilisateur ». Nous pourrions dans une certaine mesure parler de processeur orienté « auteur ». Un auteur pourrait programmer l'instruction « Le mannequin vert pâle...» comme étant une instruction de base du processeur.

Cette notion de spécialisation d'un processeur par l'auteur n'est pas utopique. Le processeur spécifique que nous développons est réalisé avec des composants programmables et reprogrammables « EPLD ». Pour une architecture matérielle donnée c est cette programmation qui définit le jeu d'instruction du processeur. Or les outils qui permettent de définir nos instructions machine, donc de fabriquer notre propre processeur, sont—à mon avis — accessibles pour un auteur connaissant un langage de haut niveau,

C’est pour cette raison que nous pourrions oser parler du « processeur auteur »,ou de « silicium auteur ».

Exemple d’un espace interactif.

Dans l'exemple ici présenté — un voyage en autobus — le sujet interagit avec des objets simulés. Ce n'est bien entendu, qu'un exemple.

Le voyage en autobus

Un passager se propose de voyager dans un autobus invisible qui se trouve non représenté dans l’espace physique.

Quand le sujet entre dans l'espace physique il est averti de la présence de l'autobus par une photographie qui représente l'autobus immobilisé. Il se déplace en aveugle dans l'espace jusqu'au moment où il touche l'extérieur du véhicule invisible. Il est alors informé de sa position et un texte lui demande de trouver la porte d'entrée. Quand il la trouve, une photographie de la porte est représentée sur les espaces virtuels. Il peut avancer pour monter dans l'autobus. Une fois dans le véhicule, s’il désire le voir démarrer, il doit s’adresser au conducteur et donc d’abord le trouver. Lors de ses déplacements à tâtons, le voyageur se heurte aussi bien aux passagers qu’au conducteur qu’il recherche. Dans tous les cas, les occupants sont représentés dans l'espace virtuel par des photographies, etc...

Ce début de scénario est un exemple qui utilise une représentation simulée des objets.

Conclusion : l’objectif des travaux

L’objectif est de proposer une structure d'accueil aux auteurs d'applications de vidéo-interactive désireux de tester ou d'utiliser l'interactivité par le déplacement.

Nous travaillons actuellement au développement du processeur chargé de calculer les relations entre le sujet et les objets, ainsi qu'à la mise en place d'applications fonctionnelles dont le but est de mettre en évidence des champs applicatifs pour ce type d’interactivité.

Notes

- ↑ Cette communication fait suite à « La Vidéo pour l'invisible », état des travaux présenté au Colloque « Communication interactive » Paris 23.1.89. présentée au colloque de janvier 1990